La Federación de Consumidores y Usuarios (CECU) valora ’’positiva’’ la decisión de la Agencia Española de Protección de Datos (AEPD) de iniciar de oficio actuaciones de investigación a la empresa estadounidense OpenAI, propietaria del servicio ChatGPT, por un posible incumplimiento de la normativa.

La Agencia llevó esta semana a la reunión plenaria con el Comité Europeo de Protección de la necesidad de abordar conjuntamente una discusión sobre el servicio ChatGPT. Como resultado, el Comité inició este jueves un grupo de trabajo específico para abordar el tema.

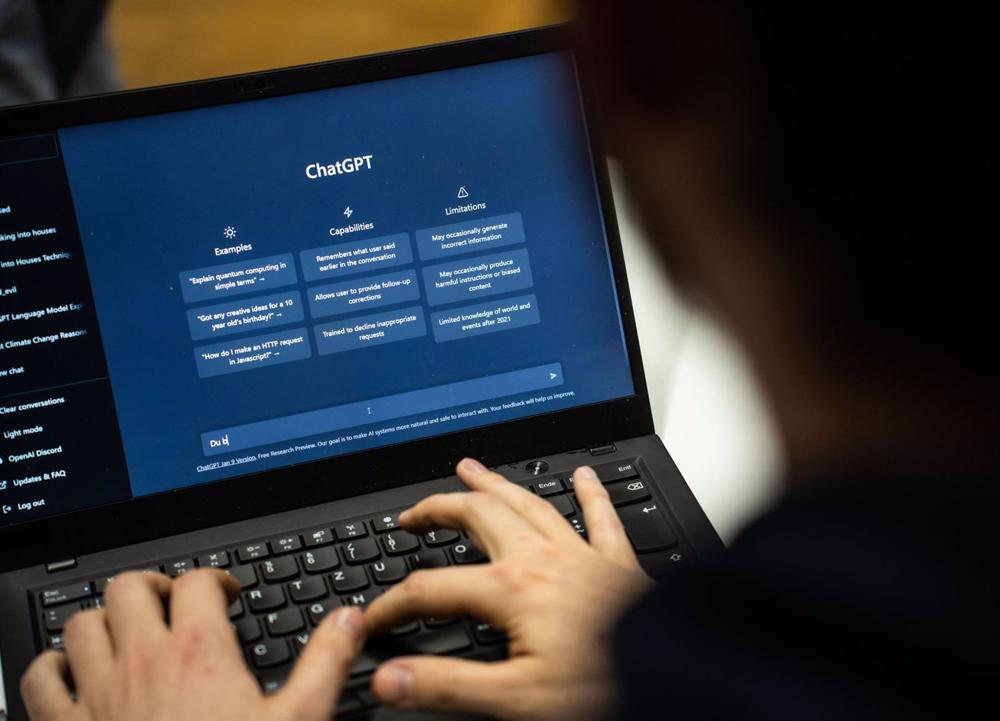

Desde CECU recuerdan que la Inteligencia Artificial ’’se ha desarrollado enormemente durante los últimos años’’. ’’En particular, desde hace un tiempo hemos visto como ChatGPT ha acaparado nuestra atención. No solo por su repentino uso masivo, sino por distintas noticias de las que hemos ido tomando conocimiento’’, señala.

La organización ha lamentado que en Bélgica ’’una persona se ha quitado la vida aparentemente tras hablar de forma intensiva con un chatbot’’. Por otro lado, ha destacado que distintas personalidades académicas ’’han llamado a la acción urgente por los riesgos que conllevan estas tecnologías’’, a lo que se suma la carta abierta firmada por expertos y ejecutivos del sector para pedir una pausa ’’inmediata’’ de seis meses en el avance de los sistemas de IA ’’más potentes’’ que ChatGPT-4.

Hace unas semanas, según apunta CECU, Italia ’’se convirtió en uno de los primeros en tomar cartas en el asunto, en tanto su autoridad de protección de datos bloqueó la utilización de ChatGPT’’. ’’Con esta decisión de la AEPD, España da un paso adelante para afrontar los riesgos que plantean estas tecnologías’’, sentencia la organización.

Asimismo, la entidad ha advertido de que ’’los riesgos a los que se encuentran expuestas las personas consumidoras, como la manipulación y la desinformación, son actuales’’ y que ’’existe hoy en día una ausencia de regulación, por lo que resulta necesaria la actuación de las autoridades públicas’’.

’’Hemos visto cómo un sistema de Inteligencia Artificial como el ChatGPT ha generalizado su uso de manera demasiado rápida. Sin embargo, no hay un marco regulatorio ni un análisis de riesgos que proteja a las personas consumidoras’’, ha subrayado la experta en derechos digitales de CECU Anabel Arias.

En su opinión, que la AEPD inicie una investigación ’’es un primer paso necesario para garantizar mayor control y protección’’. ’’Ya no podemos esperar a que se apruebe el Reglamento de IA, por lo que las autoridades públicas deben actuar proactivamente para protegernos y aplicar el principio de precaución. Es necesario un debate profundo con implicación de la sociedad civil antes de generalizar estas tecnologías’’, concluye.

Fuente: (EUROPA PRESS)